Test de normalité

En statistiques, les tests de normalité permettent de vérifier si des données réelles suivent une loi normale ou non. Les tests de normalité sont des cas particuliers des tests d'adéquation (ou tests d'ajustement, tests permettant de comparer des distributions), appliqués à une loi normale.

Ces tests prennent une place importante en statistiques. En effet, de nombreux tests supposent la normalité des distributions pour être applicables. En toute rigueur, il est indispensable de vérifier la normalité avant d'utiliser les tests. Cependant, de nombreux tests sont suffisamment robustes pour être utilisables même si les distributions s'écartent de la loi normale.

Approches empiriques et graphiques

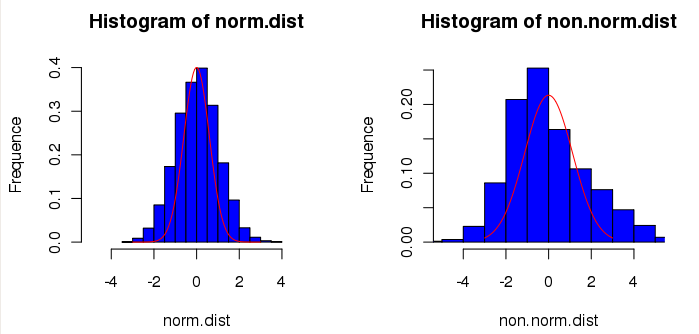

Histogramme de la distribution

Il est possible de visualiser la forme de la distribution des données à analyser en les représentant sous forme d'histogramme puis de comparer la forme de cet histogramme avec une courbe représentant une loi normale (les paramètres de cette loi étant calculés à partir des données à analyser). Ceci ne permet pas de conclure à la normalité des données mais peut donner une idée du type de loi sous-jacente : loi normale, loi de Cauchy ou loi de Student si la distribution semble symétrique, loi log-normale, loi gamma, loi de Weibull, loi exponentielle ou loi bêta si la distribution est asymétrique.

Histogramme des résidus

Il est également possible de représenter l'histogramme des résidus (c'est-à-dire la différence entre la distribution observée et la loi normale). Les résidus doivent suivre également une loi normale.

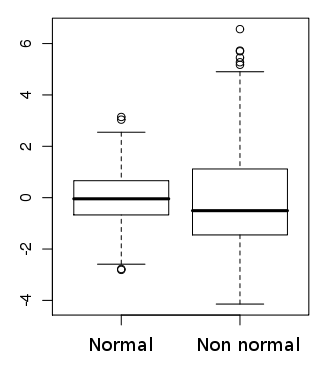

Boîte à moustaches (box-plot)

Une boîte à moustaches permet de visualiser rapidement la symétrie de la distribution des données réelles et la présence de valeurs atypiques.

Graphe quantile-quantile (qq-plot)

Coefficients d'asymétrie et d'aplatissement

Les Coefficients d'asymétrie et d'aplatissement sont également utiles pour définir une loi normale.

Pour l'aplatissement :

et pour l'asymétrie :

avec est la racine d'un estimateur non biaisé de la variance.

On sait effectivement que le coefficient d'asymétrie vaut zéro pour toute loi normale, tandis que le coefficient d'aplatissement vaut 3 (0 si normalisé)

Approche probabiliste

Il existe également un grand nombre de tests de normalité:

- Tests basés sur la fonction de répartition empirique : Test de Kolmogorov-Smirnov et son adaptation le test de Lilliefors, ou le test de Anderson-Darling et le test de Cramer-Von Mises

- Tests basés sur les moments, comme le Test de Jarque-Bera ou le test de D'Agostino.

- ou encore le test de Shapiro-Wilk, ou le test de Shapiro–Francia.

Un article de 2011 du Journal of Statistical Modeling and Analytics[1] conclut que Shapiro-Wilk a la meilleure puissance pour un niveau de signifiance donné, suivi de près par Anderson-Darling, en comparant les tests de Shapiro-Wilk, Kolmogorov-Smirnov, Lilliefors, et Anderson-Darling.

Généralités

Les tests de normalité sont des tests d'hypothèse. En notant la fonction de répartition basée sur les données à analyser et la fonction de répartition théorique, les hypothèses nulle et alternative peuvent s'écrire :

.

Les tests sur les moments ont une hypothèse moins forte, ils ne testent pas si la fonction de répartition est normale, mais si les moments (coefficients d'asymétrie et d'aplatissement) de la distribution inconnue sont identiques à ceux d'une loi normale:

On remarquera que ce n'est pas suffisant pour caractériser une loi normale (Problème des moments).

Test d'adéquation du χ²

Son utilisation n'est pas recommandée du fait de son manque de puissance et de la nécessité de diviser les distributions en classes[2].

Tests bayesiens

Applications

Une application des tests de normalité concerne les résidus d’un modèle de régression linéaire. S’il ne sont pas distribués de façon normale, les résidus ne peuvent pas être utilisés dans des tests Z ou dans quelqu’autre test que ce soit, à partir du moment où il fait intervenir des hypothèses de normalité (par exemple, le test t, le test de Fisher ou le test du χ²). Si les résidus ne sont pas normalement distribués, cela signifie que la variable dépendante, ou tout au moins une variable explicative, pourrait avoir une fonction de répartition erronée ; des variables importantes peuvent également être manquantes. Une ou plusieurs correction de ces erreurs classiques peuvent engendrer des résidus qui suivent une distribution normale.

Voir aussi

- Gilbert Saporta, Probabilités, Analyse des données et Statistiques, Paris, Éditions Technip, , 622 p. [détail des éditions] (ISBN 978-2-7108-0814-5, présentation en ligne) (p. 359 à 370).

- Judge et al., Introduction to the Theory and Practice of Econometrics, Second Édition, 1988; 890–892.

- Gujarati, Damodar N., Basic Econometrics, Fourth Édition, 2003; 147–148

Références

- Razali, Nornadiah; Wah, Yap Bee (2011). "Power comparisons of Shapiro-Wilk, Kolmogorov-Smirnov, Lilliefors and Anderson-Darling tests". Journal of Statistical Modeling and Analytics 2 (1): 21–33.

- Judge et al. (1988) and Gujarati (2003) recommandent le test de Jarque–Bera.