Matrice symétrique

En algèbre linéaire et multilinéaire, une matrice symétrique est une matrice carrée qui est égale à sa propre transposée, c'est-à-dire telle que ai,j = aj,i pour tous i et j compris entre 1 et n, où les ai,j sont les coefficients de la matrice et n est son ordre.

Exemples[modifier | modifier le code]

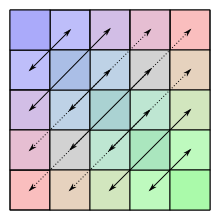

Les coefficients d'une matrice symétrique sont symétriques par rapport à la diagonale principale (du coin en haut à gauche jusqu'à celui en bas à droite). La matrice suivante est donc symétrique :

Toute matrice diagonale est symétrique.

Propriétés[modifier | modifier le code]

- Une matrice représentant une forme bilinéaire est symétrique si et seulement si cette dernière est symétrique.

- L'ensemble des matrices symétriques d'ordre n à coefficients dans un corps commutatif est un sous-espace vectoriel de dimension n(n+1)/2 de l'espace vectoriel des matrices carrées d'ordre n, et si la caractéristique du corps est différente de 2, un sous-espace supplémentaire est celui des matrices antisymétriques.

Matrices symétriques réelles[modifier | modifier le code]

Décomposition spectrale[modifier | modifier le code]

Dans un espace euclidien, une matrice représentant un endomorphisme dans une base orthonormée est symétrique si et seulement si l'endomorphisme est autoadjoint. Le théorème spectral en dimension finie en déduit que toute matrice symétrique à coefficients réels est diagonalisable à l'aide d'une matrice de passage orthogonale, car les valeurs propres d'un endomorphisme autoadjoint sont réelles et ses sous-espaces propres sont orthogonaux.

Numériquement, le procédé de diagonalisation s'applique à toute matrice symétrique et il consiste à la décomposer sous la forme

où est une matrice orthogonale (dont les colonnes sont des vecteurs propres de ) et où est une matrice diagonale dont les coefficients sont précisément les valeurs propres de .

Remarque : une matrice symétrique à coefficients complexes peut ne pas être diagonalisable. Par exemple, la matrice

admet 0 comme seule valeur propre ; si elle était diagonalisable, elle serait nulle. L'analogue complexe des matrices symétriques réelles est en fait les matrices hermitiennes (qui, elles, sont diagonalisables).

Inégalité de trace de Ky Fan[modifier | modifier le code]

Notons l'espace vectoriel des matrices réelles symétriques d'ordre n et , , les valeurs propres de , que l'on range par ordre décroissant :

On introduit l'application

et, pour un vecteur colonne , on note le vecteur ligne transposé et la matrice diagonale dont le coefficient d'indice est .

Inégalité de trace de Ky Fan — Pour tout et , on a

où 〈⋅, ⋅〉 désigne le produit scalaire canonique sur , avec égalité si et seulement si l'on peut obtenir les décompositions spectrales ordonnées et de et par la même matrice orthogonale, c'est-à-dire si et seulement si

Remarques

- L'inégalité de trace ci-dessus a été publiée par Ky Fan en 1949[1] mais elle est reliée étroitement à un travail antérieur de von Neumann (1937[2]). La condition pour avoir l'égalité est due à C. M. Teobald (1975[3]).

- D'après la traduction ci-dessus en matière d'endomorphismes autoadjoints, et sont simultanément diagonalisables si et seulement si elles commutent, et la matrice de passage peut alors être choisie orthogonale. La condition énoncée ci-dessus pour avoir l'égalité dans l'inégalité de Ky Fan est plus forte, car elle requiert que les matrices diagonales obtenues soient ordonnées. Ainsi, et commutent mais diffère de .

- L'inégalité de Ky Fan est un raffinement de l'inégalité de Cauchy-Schwarz sur le sous-espace euclidien de , dans le sens où cette dernière peut se déduire de la première. En effet, si avec orthogonale, on a

- En appliquant l'inégalité de Ky Fan à des matrices diagonales, on trouve une inégalité de Hardy, Littlewood et Pólya[4], simple à démontrer directement, selon laquelle le produit scalaire euclidien de deux vecteurs et est majoré par celui des vecteurs et obtenus à partir des vecteurs précédents en ordonnant leurs composantes par ordre décroissant :

Matrices symétriques positives[modifier | modifier le code]

Une matrice S symétrique réelle d'ordre n est dite :

- positive si la forme (bilinéaire symétrique) associée est positive, c'est-à-dire si

- définie positive si la forme associée est définie et positive, c'est-à-dire si

Remarque : une matrice carrée réelle vérifiant une telle inégalité (large ou même stricte) n'est pas nécessairement symétrique (cf. Matrice de rotation plane).

Utilisations concrètes[modifier | modifier le code]

Une matrice symétrique d'ordre 3 représente une conique en coordonnées homogènes dans un plan projectif construit à partir de .

Annexes[modifier | modifier le code]

Notes[modifier | modifier le code]

- (en) K. Fan (1949). On a theorem of Weyl concerning eigenvalues of linear transformations. Proceedings of the National Academy of Sciences of U.S.A. 35, 652-655. [lire en ligne]

- (en) J. von Neumann (1937). Some matrix inequalities and metrization of matric-space. Tomsk University Review 1, 286-300. In Collected Works, Pergamon, Oxford, 1962, Volume IV, 205-218.

- (en) C.M. Teobald (1975). An inequality for the trace of the product of two symmetric matrices. Mathematical Proceedings of the Cambridge Philosophical Society 77, 265-266.

- (en) G. H. Hardy, J. E. Littlewood et G. Pólya, Inequalities, Cambridge University Press, Cambridge, U.K., 1952.

Ouvrage de référence[modifier | modifier le code]

(en) J. M. Borwein et A. S. Lewis, Convex Analysis an Nonlinear Optimization, New York, Springer,

![{\displaystyle [x]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/07548563c21e128890501e14eb7c80ee2d6fda4d)

![{\displaystyle [y]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/f637a17dac262ee0fc8d58e31d08ca3ebe5a0fed)

![{\displaystyle \forall \,x,y\in \mathbb {R} ^{n}:\qquad x^{\mathsf {T}}y\leqslant [x]^{\mathsf {T}}[y].}](https://wikimedia.org/api/rest_v1/media/math/render/svg/a457946928ce09c162462d7a5f8d6029f5acc218)