Machine à vecteurs de support

| Type |

Algorithme de classification (d), apprentissage supervisé |

|---|---|

| Nom court |

(en) SVM |

| Inventeurs | |

| Décrit par |

Automation and Remote Control (en) |

Les machines à vecteurs de support ou séparateurs à vaste marge (en anglais support-vector machine, SVM) sont un ensemble de techniques d'apprentissage supervisé destinées à résoudre des problèmes de discrimination[note 1] et de régression. Les SVM sont une généralisation des classifieurs linéaires.

Les séparateurs à vaste marge ont été développés dans les années 1990 à partir des considérations théoriques de Vladimir Vapnik sur le développement d'une théorie statistique de l'apprentissage : la théorie de Vapnik-Tchervonenkis. Ils ont rapidement été adoptés pour leur capacité à travailler avec des données de grandes dimensions, le faible nombre d'hyperparamètres, leurs garanties théoriques, et leurs bons résultats en pratique.

Les SVM ont été[Quand ?] appliqués à de nombreux domaines (bio-informatique, recherche d'information, vision par ordinateur, finance[1]…). Selon les données, la performance des machines à vecteurs de support est de même ordre, ou même supérieure, à celle d'un réseau de neurones ou d'un modèle de mélanges gaussiens[réf. souhaitée].

Historique[modifier | modifier le code]

Les séparateurs à vastes marges reposent sur deux idées clés : la notion de marge maximale et la notion de fonction noyau. Ces deux notions existaient depuis plusieurs années avant qu'elles ne soient mises en commun pour construire les SVM.

L'idée des hyperplans à marge maximale a été explorée dès 1963 par Vladimir Vapnik et A. Lerner[2], et en 1973 par Richard Duda et Peter Hart dans leur livre Pattern Classification[3]. Les fondations théoriques des SVM ont été explorées par Vapnik et ses collègues dans les années 70 avec le développement de la théorie de Vapnik-Tchervonenkis, et par Valiant et la théorie de l'apprentissage PAC[4].

L'idée des fonctions noyaux n'est pas non plus nouvelle : le théorème de Mercer date de 1909[5], et l'utilité des fonctions noyaux dans le contexte de l'apprentissage artificiel a été montré dès 1964 par Aizermann, Bravermann et Rozoener[6].

Ce n'est toutefois qu'en 1992 que ces idées seront bien comprises et rassemblées par Boser, Isabelle Guyon et Vapnik dans un article, qui est l'article fondateur des séparateurs à vaste marge[7]. L'idée des variables ressorts, qui permet de résoudre certaines limitations pratiques importantes, ne sera introduite qu'en 1995. À partir de cette date, qui correspond à la publication du livre de Vapnik[8], les SVM gagnent en popularité et sont utilisés dans de nombreuses applications.

Un brevet américain sur les SVM est déposé en 1997 par les inventeurs originels[9].

Résumé intuitif[modifier | modifier le code]

Les séparateurs à vastes marges sont des classificateurs qui reposent sur deux idées clés, qui permettent de traiter des problèmes de discrimination non linéaire, et de reformuler le problème de classement comme un problème d'optimisation quadratique.

La première idée clé est la notion de marge maximale. La marge est la distance entre la frontière de séparation et les échantillons les plus proches. Ces derniers sont appelés vecteurs supports. Dans les SVM, la frontière de séparation est choisie comme celle qui maximise la marge[note 2],[10]. Le problème est de trouver cette frontière séparatrice optimale, à partir d'un ensemble d'apprentissage. Ceci est fait en formulant le problème comme un problème d'optimisation quadratique, pour lequel il existe des algorithmes connus.

Afin de pouvoir traiter des cas où les données ne sont pas linéairement séparables, la deuxième idée clé des SVM est de transformer l'espace de représentation des données d'entrées en un espace de plus grande dimension (possiblement de dimension infinie), dans lequel il est probable qu'il existe une séparation linéaire. Ceci est réalisé grâce à une fonction noyau[note 3], qui a l'avantage de ne pas nécessiter la connaissance explicite de la transformation à appliquer pour le changement d'espace. Les fonctions noyau permettent de transformer un produit scalaire dans un espace de grande dimension, ce qui est coûteux, en une simple évaluation ponctuelle d'une fonction. Cette technique est connue sous le nom de kernel trick (ou astuce du noyau).

Principe général[modifier | modifier le code]

Les SVM peuvent être utilisés pour résoudre des problèmes de discrimination, c'est-à-dire décider à quelle classe appartient un échantillon, ou de régression, c'est-à-dire prédire la valeur numérique d'une variable. La résolution de ces deux problèmes passe par la construction d'une fonction qui à un vecteur d'entrée fait correspondre une sortie :

On se limite pour l'instant à un problème de discrimination à deux classes (discrimination binaire), c'est-à-dire , le vecteur d'entrée étant dans un espace X muni d'un produit scalaire. On peut prendre par exemple .

Discrimination linéaire et hyperplan séparateur[modifier | modifier le code]

Le cas simple est le cas d'une fonction discriminante linéaire, obtenue par combinaison linéaire du vecteur d'entrée , avec un vecteur de poids :

La frontière de décision est un hyperplan, appelé hyperplan séparateur, ou séparatrice. Le signe de , qui donne le côté de l'hyperplan dans lequel est localisé, permet alors de décider la classe de . Il est alors décidé que est de classe 1 si et de classe -1 sinon. C'est un classifieur linéaire.

Le but d'un algorithme d'apprentissage supervisé est d'apprendre la fonction h(x) par le biais d'un ensemble d'apprentissage :

- ×

où les sont les points dans un espace de dimension , les sont les labels qui valent , est la taille de l'ensemble d'apprentissage, et la dimension des vecteurs d'entrée. Si le problème est linéairement séparable, alors le signe de est égal à pour tout . Dit autrement :

Exemple[modifier | modifier le code]

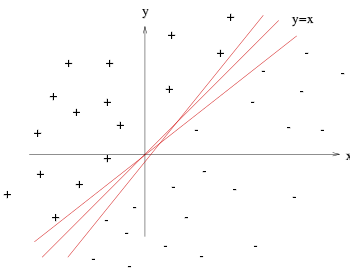

Imaginons un plan (espace à deux dimensions) dans lequel sont répartis deux groupes de points. Ces points sont associés à un groupe : les points (+) pour y > x et les points (-) pour y < x. On peut trouver un séparateur linéaire évident dans cet exemple, la droite d'équation y = x. Le problème est dit linéairement séparable.

Pour des problèmes plus compliqués, il n'existe en général pas de séparatrice linéaire. Imaginons par exemple un plan dans lequel les points (-) sont regroupés à l'intérieur d'un cercle, avec des points (+) tout autour : aucun séparateur linéaire ne peut correctement séparer les groupes : le problème n'est pas linéairement séparable. Il n'existe pas d'hyperplan séparateur.

|

|

Marge maximale[modifier | modifier le code]

On se place désormais dans le cas où le problème est linéairement séparable. Même dans ce cas simple, le choix de l'hyperplan séparateur n'est pas évident. Il existe en effet une infinité d'hyperplans séparateurs. On le voit bien en deux dimensions comme montré dans la figure ci-dessous : on continue à séparer les points positifs des points négatifs si on bouge et tourne un peu une droite qui les séparait déjà. Toutes ces hyperplans séparateurs ont les performances en apprentissage sont identiques (le risque empirique est le même), mais les performances en généralisation peuvent être très différentes.

Pour résoudre ce problème, il a été montré par Vapnik et Kotz en 1982[11], qu'il existe un unique hyperplan optimal. Il est défini comme l'hyperplan qui maximise la marge entre les échantillons et l'hyperplan séparateur. On veut que l'hyperplan choisi (par exemple la droite en deux dimensions) soit la plus loin des points. Il existe des raisons théoriques à ce choix. Vapnik et Kotz ont montré[11] que la capacité des classes d'hyperplans séparateurs diminue lorsque leur marge augmente.

La marge est la distance entre l'hyperplan et les échantillons les plus proches. Ces derniers sont appelés vecteurs supports. On rappelle que l'hyperplan à trouver est paramétré par les poids w et w0 et que son équation . Le but est de trouver les poids w et w0 afin de maximiser la marge. Etant donné un tel hyperplan, la marge est définie par . Le minimum sur k permet de trouver l'échantillon le plus proche de l'hyperplan. Ainsi, l'hyperplan qui maximise la marge est donné par :

- .

Recherche de l'hyperplan optimal[modifier | modifier le code]

Formulation primale[modifier | modifier le code]

La marge est la plus petite distance entre les échantillons d'apprentissage et l'hyperplan séparateur qui satisfasse la condition de séparabilité (à savoir comme expliqué précédemment). La distance d'un échantillon xk à l'hyperplan est donnée par sa projection orthogonale sur le vecteur de poids[note 4] :

- .

L'hyperplan séparateur (w,w0) de marge maximale est donc donné par :

Afin de faciliter l'optimisation, on choisit de normaliser w et w0, de telle manière que les échantillons à la marge ( pour les vecteurs supports sur la frontière positive, et pour ceux situés sur la frontière opposée) satisfassent :

D'où pour tous les échantillons,

Cette normalisation est parfois appelée la forme canonique de l'hyperplan, ou hyperplan canonique[12].

Avec cette mise à l'échelle, la marge vaut désormais , il s'agit donc de maximiser . La formulation dite primale des SVM s'exprime alors sous la forme suivante[note 5] :

Ceci peut se résoudre par la méthode des multiplicateurs de Lagrange, où le lagrangien est donné par :

Le lagrangien doit être minimisé par rapport à w et w0, et maximisé par rapport à α.

Formulation duale[modifier | modifier le code]

En annulant les dérivées partielles du lagrangien, selon les conditions de Kuhn-Tucker, on obtient :

En réinjectant ces valeurs dans l'équation , on obtient la formulation duale :

Ce qui donne les multiplicateurs de Lagrange optimaux .

Afin d'obtenir l'hyperplan solution, on remplace w par sa valeur optimale w*, dans l'équation de l'hyperplan , ce qui donne :

Conséquences[modifier | modifier le code]

- Il y a trois remarques intéressantes à faire à propos de ce résultat. La première découle de l'une des conditions de Kuhn-Tucker, qui donne :

- d'où

- .

- Les seuls points pour lesquels les contraintes du lagrangien sont actives sont donc les points tels que , qui sont les points situés sur les hyperplans de marges maximales. En d'autres termes, seuls les vecteurs supports participent à la définition de l'hyperplan optimal.

- La deuxième remarque découle de la première. Seul un sous-ensemble restreint de points est nécessaire pour le calcul de la solution, les autres échantillons ne participant pas du tout à sa définition. Ceci est donc efficace au niveau de la complexité. D'autre part, le changement ou l'agrandissement de l'ensemble d'apprentissage a moins d'influence que dans un modèle de mélanges gaussiens par exemple, où tous les points participent à la solution. En particulier, le fait d'ajouter des échantillons à l'ensemble d'apprentissage qui ne sont pas des vecteurs supports n'a aucune influence sur la solution finale.

- La dernière remarque est que l'hyperplan solution ne dépend que du produit scalaire entre le vecteur d'entrée et les vecteurs supports. Cette remarque est l'origine de la deuxième innovation majeure des SVM : le passage par un espace de redescription grâce à une fonction noyau.

Cas non séparable : Astuce du noyau (kernel trick)[modifier | modifier le code]

Principe[modifier | modifier le code]

La notion de marge maximale et la procédure de recherche de l'hyperplan séparateur telles que présentées pour l'instant ne permettent de résoudre que des problèmes de discrimination linéairement séparables. C'est une limitation sévère qui condamne à ne pouvoir résoudre que des problèmes jouets, ou très particuliers. Afin de remédier au problème de l'absence de séparateur linéaire, l'idée de l'astuce du noyau (en anglais kernel trick) est de reconsidérer le problème dans un espace de dimension supérieure, éventuellement de dimension infinie. Dans ce nouvel espace, il est alors probable qu'il existe une séparation linéaire.

Plus formellement, on applique aux vecteurs d'entrée x une transformation non-linéaire . L'espace d'arrivée est appelé espace de redescription. Dans cet espace, on cherche alors l'hyperplan

qui vérifie

- , pour tous les points de l'ensemble d'apprentissage, c'est-à-dire l'hyperplan séparateur dans l'espace de redescription.

En utilisant la même procédure que dans le cas sans transformation, on aboutit au problème d'optimisation suivant :

Le problème de cette formulation est qu'elle implique un produit scalaire entre vecteurs dans l'espace de redescription, de dimension élevée, ce qui est couteux en termes de calculs. Pour résoudre ce problème, on utilise une astuce connue sous le nom de Kernel trick, qui consiste à utiliser une fonction noyau, qui vérifie :

d'où l'expression de l'hyperplan séparateur en fonction de la fonction noyau :

L'intérêt de la fonction noyau est double :

- Le calcul se fait dans l'espace d'origine, ceci est beaucoup moins coûteux qu'un produit scalaire en grande dimension.

- La transformation n'a pas besoin d'être connue explicitement, seule la fonction noyau intervient dans les calculs. On peut donc envisager des transformations complexes, et même des espaces de redescription de dimension infinie.

Choix de la fonction noyau[modifier | modifier le code]

En pratique, on ne connaît pas la transformation , on construit plutôt directement une fonction noyau. Celle-ci doit respecter certaines conditions, elle doit correspondre à un produit scalaire dans un espace de grande dimension. Le théorème de Mercer explicite les conditions que doit satisfaire pour être une fonction noyau : elle doit être symétrique, semi-définie positive.

L'exemple le plus simple de fonction noyau est le noyau linéaire :

On se ramène donc au cas d'un classifieur linéaire, sans changement d'espace. L'approche par Kernel trick généralise ainsi l'approche linéaire. Le noyau linéaire est parfois employé pour évaluer la difficulté d'un problème.

Des noyaux usuels employés avec les SVM sont :

- le noyau polynomial ;

- le noyau gaussien .

Extensions[modifier | modifier le code]

Marge souple[modifier | modifier le code]

En général, il n'est pas non plus possible de trouver une séparatrice linéaire dans l'espace de redescription. Il se peut aussi que des échantillons soient mal étiquetés, et que l'hyperplan séparateur ne soit pas la meilleure solution au problème de classement.

En 1995, Corinna Cortes et Vladimir Vapnik proposent une technique dite de marge souple[13], qui tolère les mauvais classements. La technique cherche un hyperplan séparateur qui minimise le nombre d'erreurs grâce à l'introduction de variables ressort (slack variables en anglais), qui permettent de relâcher les contraintes sur les vecteurs d'apprentissage :

Avec les contraintes précédentes, le problème d'optimisation est modifié par un terme de pénalité, qui pénalise les variables ressort élevées :

où est une constante qui permet de contrôler le compromis entre nombre d'erreurs de classement, et la largeur de la marge. Elle doit être choisie par l'utilisateur, en général par une recherche exhaustive dans l'espace des paramètres, en utilisant par exemple la validation croisée sur l'ensemble d'apprentissage. Le choix automatique de ce paramètre de régularisation est un problème statistique majeur.

Cas multi-classe[modifier | modifier le code]

Plusieurs méthodes ont été proposées pour étendre le schéma ci-dessus au cas où plus de deux classes sont à séparer. Ces schémas sont applicables à tout classifieur binaire, et ne sont donc pas spécifiques aux SVM[14]. Les deux plus connues sont appelées one versus all et one versus one. Formellement, les échantillons d'apprentissage et de test peuvent ici être classés dans classes .

La méthode one-versus-all (appelée parfois one-versus-the-rest) consiste à construire classifieurs binaires en attribuant le label 1 aux échantillons de l'une des classes et le label -1 à toutes les autres. En phase de test, le classifieur donnant la valeur de confiance (e.g la marge) la plus élevée remporte le vote.

La méthode one-versus-one consiste à construire classifieurs binaires en confrontant chacune des classes. En phase de test, l'échantillon à classer est analysé par chaque classifieur et un vote majoritaire permet de déterminer sa classe. Si l'on note l'échantillon à classer et le classifieur SVM séparant la classe et la classe et renvoyant le label attribué à l'échantillon à classer, alors le label attribué à peut formellement se noter . C'est la classe qui sera le plus souvent attribuée à quand il aura été analysé par tous les . Il peut exister une ambigüité dans le résultat du comptage, s'il n'existe pas de vote majoritaire[15]

Une généralisation de ces méthodes a été proposée en 1995[16] sous le nom d'ECOC, consistant à représenter les ensembles de classifieurs binaires comme des codes sur lesquels peuvent être appliqués les techniques de correction d'erreur.

Ces méthodes souffrent toutes de deux défauts. Dans la version one-versus-all, rien n'indique que les valeurs du résultat de classification des classifieurs soient comparables (pas de normalisation, donc possibles problèmes d'échelle)[15]. De plus le problème n'est plus équilibré, par exemple avec M=10, on utilise seulement 10 % d'exemples positifs pour 90 % d'exemples négatifs.

SVM pour la régression[modifier | modifier le code]

Vladimir Vapnik, Harris Drucker, Chris Burges, Linda Kaufman et Alex Smola ont proposé en 1996 une méthode pour utiliser des SVM afin de résoudre des problèmes de régression[17].

Notes et références[modifier | modifier le code]

- Notes

- Le terme anglais pour discrimination est classification, qui a un sens différent en français (se rapporte au clustering). On utilise aussi le terme classement à la place de discrimination, plus proche du terme anglais, et plus compréhensible.

- Ce choix est justifié par la théorie de Vapnik-Tchervonenkis (ou théorie statistique de l'apprentissage), qui montre que la frontière de séparation de marge maximale possède la plus petite capacité.

- La fonction noyau doit respecter les conditions du théorème de Mercer.

- Pour un hyperplan d'équation , la distance de tout point a de l'espace à l'hyperplan est

- Maximiser est équivalent à minimiser . Le carré est pris pour se débarrasser de la racine carrée incluse dans la norme. Le 1/2 n'est présent que pour faciliter la lisibilité des calculs et du résultat de l'optimisation.

- Références

- (en) Bernhard Schölkopf, Alexander J. Smola, Learning With Kernels: Support Vector Machines, Regularization, Optimization and Beyond, 2002, MIT Press.

- (en) Vladimir Vapnik et A. Lerner, Pattern Recognition using Generalized Portrait Method, Automation and Remote Control, 1963.

- (en) Richard O. Duda, Peter E. Hart, David G. Stork, Pattern Classification, Wiley-interscience, (ISBN 0-471-05669-3) [détail des éditions].

- (en) L.G. Valiant. A Theory of the Learnable, Communications of the ACM, 27(11), p. 1 134-1 142, novembre 1984.

- (en) J. Mercer, Functions of Positive and Negative Type, and their Connection with the Theory of Integral Equations. Philos. Trans. Roy. Soc. London, A 209:415--446, 1909.

- M. Aizerman, E. Braverman, and L. Rozonoer, Theoretical foundations of the potential function method in pattern recognition learning, Automation and Remote Control 25:821--837, 1964.

- (en) Bernhard E. Boser, Isabelle M. Guyon, Vladimir N. Vapnik, A Training Algorithm for Optimal Margin Classifiers In Fifth Annual Workshop on Computational Learning Theory, pages 144--152, Pittsburgh, ACM. 1992

- V. Vapnik, The Nature of Statistical Learning Theory, N-Y, Springer-Verlag, 1995.

- (en) Pattern recognition system using support vectors. B. Boser, I. Guyon, and V. Vapnik, US Patent 5,649,068 1997.

- (en) Marti A. Hearst, Support Vector Machines, IEEE Intelligent Systems, vol. 13, no. 4, p. 18-28, Jul/Aug, 1998

- V. Vapnik, et S. Kotz, Estimation of Dependences Based on Empirical Data, Springer Series in Statistics, 1982, (ISBN 978-0387907338).

- (en) Bernhard Schölkopf, Alexander J. Smola, Learning With Kernels: Support Vector Machines, Regularization, Optimization and Beyond, 2002, MIT Press, p. 190

- (en) Corinna Cortes and V. Vapnik, « Support-Vector Networks », Machine Learning, 20, 1995. http://www.springerlink.com/content/k238jx04hm87j80g/.

- (en) Christopher M. Bishop, Pattern Recognition And Machine Learning, Springer, (ISBN 0-387-31073-8) [détail des éditions], p. 182-184

- (en) Christopher M. Bishop, Pattern Recognition And Machine Learning, Springer, (ISBN 0-387-31073-8) [détail des éditions], p. 338-339

- Dietterich, T.G. and Bakiri, G., Solving multiclass learning problems via error-correcting output codes. Journal of Artificial Intelligence Research. v2. 263-286.

- (en) Harris Drucker, Chris J. C. Burges, Linda Kaufman, Alex Smola and Vladimir Vapnik (1997). « Support Vector Regression Machines ». Advances in Neural Information Processing Systems 9, NIPS 1996, 155-161, MIT Press.

Voir aussi[modifier | modifier le code]

Bibliographie[modifier | modifier le code]

- (en) Vapnik, V. Statistical Learning Theory. Wiley-Interscience, New York, (1998)

- (en) Bernhard Schölkopf, Alexander J. Smola, Learning With Kernels: Support Vector Machines, Regularization, Optimization and Beyond, 2002, MIT Press.

- (en) John Shawe-Taylor, Nello Cristianini, Support Vector Machines and other kernel-based learning methods, Cambridge University Press, 2000.

- (en) Christopher J.C. Burges, A Tutorial on Support Vector Machines for Pattern Recognition, Data Mining and Knowledge Discovery, 2, 121–167 (1998)

- (en) Christopher M. Bishop, Pattern Recognition And Machine Learning, Springer, (ISBN 0-387-31073-8) [détail des éditions]

On trouve une présentation en français de la classification par les machines à vecteurs de support dans :

- Jean Beney, Classification supervisée de documents : théorie et pratique, Hermes Science, , 184p.

- Vincent Barra, Antoine Cornuéjols, Laurent Miclet, Apprentissage Artificiel : Concepts et algorithmes, Eyrolles, (ISBN 978-2-416-001-04-8) [détail des éditions]

Articles connexes[modifier | modifier le code]

- Apprentissage automatique

- Apprentissage supervisé

- Réseau de neurones

- Modèle de mélanges gaussiens

- Théorie de Vapnik-Tchervonenkis

- Machine à vecteurs de pertinence (en)

- Noyau polynomial

![{\displaystyle \arg \max _{w,w_{0}}\left\{{\frac {1}{||w||}}\min _{k}\left[l_{k}(w^{T}x_{k}+w_{0})\right]\right\}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/4570e2d3fb3ead090d601f19f26a7a5df3291c35)

![{\displaystyle \alpha _{k}[l_{k}h(x_{k})-1]=0\quad 1\leq k\leq p.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/12189990c6fd296987704e74332da83b91678756)

![{\displaystyle Card(\{h_{i,j}(x_{t})\}\cap \{k\};i,j,k\in [1,M],i<j)}](https://wikimedia.org/api/rest_v1/media/math/render/svg/57cf6df1b8838202c08ede986b6bc001f4811afc)