Ajustement affine

En mathématiques, un ajustement affine[1] est la détermination d’une droite approchant au mieux un nuage de points dans le plan.

Il est utilisé notamment en analyse de données pour évaluer la pertinence d’une relation affine entre deux variables statistiques, et pour estimer les coefficients d’une telle relation. Il permet aussi de produire une droite de tendance pour formuler des prévisions sur un comportement futur proche ou une interpolation entre deux mesures effectuées.

L’ajustement affine peut être obtenu par régression linéaire, en particulier par la méthode des moindres carrés, ou par d’autres méthodes reposant par exemple sur une segmentation des valeurs pour utiliser les phénomènes de lissage. Ces méthodes sont plus ou moins adaptées selon le contexte d’obtention des données (mesures expérimentales avec bruit, série chronologique, fonction de répartition empirique, agrégation de résultats partiels...) et les ressources disponibles en temps de calcul ou espace mémoire.

Certaines de ces méthodes se généralisent pour plus de deux variables avec la régression linéaire multiple et l’analyse en composantes principales.

Régression linéaire[modifier | modifier le code]

On note (Mi (xi , yi)) le nuage de points que l'on cherche à ajuster par une droite (d) : y = ax + b.

Une méthode de régression linéaire consiste à minimiser les résidus yi − axi − b, c’est-à-dire la distance de chaque point Mi à la droite d dans la direction de l’axe des ordonnées. Mais comme les points ne sont en général pas déjà alignés, il n’est pas possible de minimiser simultanément toutes ces distances. On distingue donc plusieurs méthodes selon la façon d’agréger ces distances.

Méthode des moindres carrés[modifier | modifier le code]

Cette méthode consiste à minimiser la somme des carrés des résidus, définie par :

Quelle que soit la répartition des points, il existe une unique droite qui minimise S, dont les coefficients s’écrivent où x est la moyenne des abscisses y est la moyenne des ordonnées : ; V(x) est la variance des abscisses et Cov(x,y) est la covariance des couples de coordonnées .

L’expression de l’ordonnée à l’origine b montre que la droite ainsi définie passe par l’isobarycentre des points, de coordonnées (x, y).

Il existe plusieurs démonstrations possibles pour justifier ces valeurs[2] dont une consiste à considérer S, pour a donné, comme une fonction du second degré en b dont on peut déterminer le minimum, puis, ce b étant exprimé par sa valeur en fonction de a, trouver le minimum de la fonction du second degré en a.

La qualité de l’ajustement affine est alors mesurée par le coefficient de corrélation linéaire où σx et σy sont les écarts types des deux variables statistiques. Il intervient dans l'évaluation de la somme des carrés des résidus :

Plus le coefficient de corrélation est proche de 1 ou –1, et plus la somme des carrés des résidus est voisine de 0. Le coefficient de corrélation est donc un bon indicateur de la validité de l'ajustement affine.

On peut aussi comprendre le rôle d'indicateur du coefficient de corrélation en observant le graphique centré sur le point moyen (de coordonnées (x, y)). Si l'ajustement affine n'est pas légitime, il y aura grossièrement autant de points dans chacun des quadrants et les produits (xi – x)(yi – y) seront de signes différents et se compenseront mutuellement quand on en fera la somme conduisant ainsi à un r petit en valeur absolue. Tandis que si l'ajustement affine est légitime, il y aura deux quadrants, de part et d'autre du point moyen, qui contiendront l'essentiel des points et les points correspondants seront donc caractérisés par le même signe dans le produit (xi – x)(yi – y), signe qui deviendra ainsi très largement majoritaire et que l'on retrouvera dans leur somme, ce qui conduit à une valeur de r grande en valeur absolue.

Enfin, l'inégalité de Cauchy-Schwarz permet d'affirmer que

avec égalité seulement si les yi – y sont proportionnels aux xi – x. Donc |r| ≤ 1 avec égalité seulement s'il existe un réel a tel que, pour tout i, yi – y = a(xi – x). Ainsi, plus |r| est proche de 1 plus l'ajustement affine semble légitime.

Une autre méthode d'interpréter le rôle joué par le coefficient de corrélation est d'observer les fluctuations de Y autour de sa moyenne. Il existe deux phénomènes qui expliquent ces fluctuations. D'une part, on sait que Y est considéré comme proche d'une fonction affine de X. Quand X fluctue autour de sa moyenne avec une variance de V(x), aX + b fluctue autour de sa moyenne y avec une variance de a2V(x), cette quantité s'appelle la variance expliquée. L'autre raison de fluctuation de Y est que le nuage de points n'est pas situé sur la droite d'ajustement : les valeurs yi et axi + b peuvent être différentes. On démontre, à partir de l'expression précédente de S, que la variance est la somme de la variance expliquée et de la variance résiduelle c'est-à-dire Sn.

Le rapport de corrélation est le rapport entre la variation expliquée (inévitable puisque X fluctue) et la variance totale. Ce rapport de corrélation est égal au carré du coefficient de corrélation r2. Plus le rapport de corrélation est proche de 1, plus la variance expliquée est proche de la variance totale et plus la variance résiduelle est faible, donc meilleur est l'ajustement affine.

Ajustement affine de X par Y[modifier | modifier le code]

On peut également ajuster le nuage de points en expliquant X par Y, c'est-à-dire en cherchant la droite (d') d'équation X = cY + d qui rend minimale la somme des carrés des distances MiRi où Ri est le projeté de Mi sur (d') parallèlement à l'axe des abscisses.

Les coefficients c et d sont alors données par

Cette droite passe aussi par le point moyen mais n'a pas toujours même pente que la précédente. Les droites ont même pente si a et c sont inverses l'un de l'autre, donc si ac vaut 1, or ac correspond à r2. On retrouve ainsi le résultat : l'ajustement de X par Y donne la même droite que l'ajustement de Y par X seulement si le coefficient de corrélation vaut 1 ou –1.

Interprétation en géométrie euclidienne de dimension n[modifier | modifier le code]

Dans l'espace , muni du produit scalaire canonique, on considère le vecteur X de coordonnées (x1, x2, ..., xn), le vecteur Y de coordonnées (y1, y2, ..., yn), le vecteur U de coordonnées (1, 1, ..., 1).

On peut remarquer que

Rechercher la droite qui minimise la somme des carrés des résidus, c'est rechercher les réels a et b tels que soit minimale. Cette norme sera minimale si et seulement si aX + bU est le projeté orthogonal de Y dans l'espace vectoriel engendré par X et U, donc dès que

La première égalité se traduit par

ce qui donne bien pour b la valeur précédemment trouvée. La seconde égalité se traduit alors par

ce qui donne bien pour a la valeur précédemment trouvée.

On peut déterminer le cosinus de l'angle θ que forment entre eux les vecteurs Y – yU et X – xU par la formule

- .

Cette égalité a du sens au regard du résultat donné par l'inégalité de Cauchy-Schwarz plus tôt. Le coefficient de corrélation peut donc être comme le cosinus de l'angle entre les deux vecteurs X et Y. Un coefficient de corrélation de 1 signifie que l'angle entre ces deux vecteurs est nul (alignement parfait), un coefficient de –1 donne un angle géométrique de π entre les deux vecteurs (vecteur de même direction mais de sens opposés) et si le coefficient de corrélation linéaire est en valeur absolue supérieur à √3/2 alors l'angle géométrique formé par les deux vecteurs est inférieur à π/6 ou supérieur à 5π/6.

Minimisation de la somme des distances[modifier | modifier le code]

Il peut sembler plus simple de chercher à minimiser la somme des distances des points à la droite, plutôt que la somme de leur carré. Cette méthode a d’ailleurs été développée antérieurement[3] à la méthode des moindres carrés. Mais il n’y a alors pas nécessairement unicité de la droite optimale, et la détermination des coefficients est beaucoup moins aisée.

Une telle droite optimale passe toujours par deux des points considérés[4].

Sélection et segmentation[modifier | modifier le code]

Dans le cas où les points du nuage ont des abscisses différentes deux à deux, en particulier dans le cas de séries chronologiques, certaines méthodes d’ajustement reposent sur la sélection de certains points censés être plus représentatifs ou le découpage de l’ensemble des points en deux ou trois parties consécutives en abscisse.

Méthode des points observés[modifier | modifier le code]

Une méthode simpliste mais facile à mettre en œuvre sans calcul, par exemple pour tracer à la main une droite de tendance sur une représentation graphique, consiste à tracer la droite reliant deux points visiblement dans l’alignement des autres[5].

Méthode des points extrêmes[modifier | modifier le code]

Une méthode plus systématique que la précédente consiste à relier les deux points d’abscisses minimale et maximale[6].

Méthode de Mayer[modifier | modifier le code]

Cette méthode d'ajustement est plus simple à mettre en place. Elle semble avoir été utilisée par Leonhard Euler et Tobias Mayer[7]. Elle consiste, après avoir rangé les couples (xi, yi) selon l'ordre croissant des xi, à partager le nuage en deux nuages de taille égale, à déterminer le point moyen de chacun des sous-nuages, et à tracer la droite reliant ces deux points moyens.

Méthode médiane-médiane[modifier | modifier le code]

Elle consiste à ranger les couples (xi, yi) selon l'ordre croissant des xi, partager alors la population en trois sous-populations de même taille (à une unité près), et rechercher dans chaque population la médiane des xi et celle des yi. Ce qui conduit à trois couples de médianes définissant trois points : P1(m1,x, m1,y), P2(m2,x, m2,y) et P3(m3,x, m3,y). La droite d'ajustement est la droite passant par l'isobarycentre de ces trois points et parallèle à la droite (P1 P3)[8].

Analyse en composantes principales[modifier | modifier le code]

Étant donné une famille de points du plan, il existe une unique droite du plan qui minimise la somme des distances au carré des points à la droite, pour peu que la covariance entre abscisses et ordonnées soit non nulle ou que la variance des abscisses soit différente de celle des ordonnées. Cette droite passe alors par l’isobarycentre des points.

Plus généralement, étant donné une famille de vecteurs de , le choix d’un sous-espace affine qui minimise la somme des carrés des distances se ramène à l’analyse en composantes principales : la matrice de covariance est symétrique positive, diagonalisable, et la somme des sous-espaces propres associés aux valeurs propres les plus grandes donne la direction d’un sous-espace affine passant par l’isobarycentre des points.

Ce procédé n’a de sens que si les coordonnées sont homogènes, par exemple si elles représentent des grandeurs exprimées avec la même unité. Sinon, on peut éventuellement normaliser au préalable chaque coordonnée pour que les variances soient identiques.

Utilisation[modifier | modifier le code]

Vraisemblance d’une corrélation[modifier | modifier le code]

Dans le cadre de la régression linéaire, l’ajustement affine permet de tester l’existence d’une corrélation linéaire entre deux variables.

Formulation de prévision et interpolation[modifier | modifier le code]

Pour une valeur en abscisse non représentée dans le nuage de points, on peut estimer une valeur en ordonnée en lui appliquant la fonction affine obtenue par ajustement affine.

Par exemple, le graphique ci-contre représente les réponses à des sondages effectués sur la période 1992-2006 concernant le pourcentage de personnes dans la tranche 15-44 ans ayant déjà goûté au cannabis. Chaque point correspond à un sondage avec sa date en abscisse et le pourcentage d'expérimentateurs en ordonnées. Le nuage de points semble s'organiser selon une droite qui permet d'estimer qu'un sondage en 2008 aurait donné 42 % de réponses positives et qu'un sondage en 1994 aurait donné environ 20 % de réponses positives.

Le tracé d'une droite d'ajustement n'induit pas qu'il existe une relation de cause à effet entre les deux phénomènes mesurés et les extrapolations que l'on est tenté d'effectuer doivent se limiter aux voisinages proches du nuage de points car, au-delà des frontières de l'étude, le comportement relatif des deux variables peut très bien ne plus être affine.

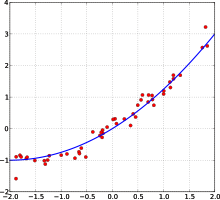

Ajustement à d’autres courbes[modifier | modifier le code]

Si le nuage de points semble indiquer une fonction exponentielle, on peut tenter un ajustement affine sur le logarithme naturel des ordonnées ln(Y), en fonction de X. En effet si ln(Y) = aX + b alors Y = eb × eaX

Si le nuage de points semble indiquer une fonction puissance, l'ajustement affine se tentera sur ln(Y) et ln(X) car si ln(Y) = a ln(X) + b alors Y = eb × Xa

Notes et références[modifier | modifier le code]

- Cette terminologie est référencée par exemple dans le programme de mathématiques de terminale en section technologique du baccalauréat et du programme du CAPES interne de sciences économiques et sociales en France.

- Voir par exemple, Dany-Jack Mercier, Cahiers de mathématiques du supérieur, volume 1 : Statistiques, probabilités, homothéties, p. 34 et suivantes, Editions Publibook, 2010, (ISBN 2748355881)

- La méthode de minimisation de la somme des distances des points à la droite a été proposée en 1757, soit 50 ans avant celle des moindres carrés, selon Gilbert Saporta, Probabilités, analyse de données et statistique, § 16.5 « Une méthode de régression robuste », Éditions Technip, Paris 2011.

- D. Birkes, Y. Dodge, Alternative methods of regression, Wiley 1993.

- Cours de Christophe Chéneau p. 13

- Présentation de la méthode sur le site de Sylvie Lacoste

- Ajustement affine sur le site Apprendre en ligne

- (en) Elizabeth J. Walters, Christopher H. Morrell, and Richard E. Auer, An Investigation of the Median-Median Method of Linear Regression, Journal of Statistics Education Volume 14, Numéro 2 (2006)

Voir aussi[modifier | modifier le code]

Bibliographie[modifier | modifier le code]

- Transmath, Term ES, programme 2002, Nathan

- Dany-Jack Mercier, Cahiers de mathématiques du supérieur, volume1 : Statistiques, probabilités, homothéties, Éditions Publibook, 2010, (ISBN 2748355881)

![{\displaystyle S=f_{a}(b)=\sum _{i=1}^{n}\left[b^{2}-2b(y_{i}-ax_{i})+(y_{i}-ax_{i})^{2}\right]=nb^{2}-2nb({\overline {y}}-a{\overline {x}})+\sum _{i=1}^{n}(y_{i}-ax_{i})^{2}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/bee27fb6a3c955c64fc9be1ac90d4cfe1b09022c)

![{\displaystyle S=g(a)=\sum _{i=1}^{n}\left[\left(y_{i}-{\overline {y}}\right)-a\left(x_{i}-{\overline {x}}\right)\right]^{2}=na^{2}\mathrm {V} (x)-2na\mathrm {Cov} (x,y)+n\mathrm {V} (y)}](https://wikimedia.org/api/rest_v1/media/math/render/svg/dc01643573ca474beb5c24073345e06b34653375)