Spectre sonore

Le spectre sonore d'un son est le tableau ou la représentation graphique des partiels qui, s'ajoutant les uns aux autres, constituent ce son.

Un son pur est une vibration sinusoïdale de l'air à une certaine fréquence et avec une certaine amplitude. Tous les sons périodiques peuvent se décomposer en une somme de sons purs, qu'on appelle partiels de ce son, qu'on dit complexe s'il est la somme de plus d'un partiel.

Quand les fréquences des partiels sont des multiples entiers d'une fréquence fondamentale, on parle d'harmoniques, et de spectre harmonique.

Les sons musicaux possèdent en général une décomposition spectrale approximativement harmonique ; mais le son d'instruments sonores comme une cloche ou un gong peut souvent se décomposer en partiels inharmoniques. Celui d'instruments de percussion, comme celui de sons naturels comme le bruit des vagues sur la plage ou du vent dans les feuilles, se décomposent en une infinité de partiels donnant un spectre continu.

La découverte de la décomposition spectrale remonte au XIXe siècle, et son étude s'est beaucoup améliorée.

Les spectres statiques ne concernent que les signaux à fréquence fixe. Dans la réalité, le spectre sonore varie en permanence. En conséquence, les sons ne sont pas des phénomènes périodiques au sens mathématique : ils ont un début et une fin. Plus la portion de son qu'on étudie est longue, plus on peut déterminer avec précision la fréquence des partiels.

Le spectre sonore s'observe avec un analyseur de spectre appelé sonagraphe.

Instruments intellectuels[modifier | modifier le code]

Mathématiques[modifier | modifier le code]

En 1822, le mathématicien Joseph Fourier montre que toute fonction décrivant un phénomène périodique peut se décrire par une série, c'est-à-dire une suite, finie ou infinie, de coefficients de fonctions sinus et cosinus dont la fréquence est un multiple entier de celle du phénomène en question. Dans les années qui suivent, ce résultat est étendu à toute fonction par la transformation de Fourier. Tout phénomène évoluant sans discontinuité dans le temps, et qui peut donc être théoriquement décrit par une fonction, même si on ne sait pas définir mathématiquement celle-ci, possède donc une description en fréquences. Cette description est son spectre.

Lorsque le phénomène, et donc, la fonction qui le décrit, est périodique, son spectre est discontinu : il ne présente de valeurs différentes de zéro que pour les fréquences multiples de sa fréquence globale, appelée fréquence fondamentale. Dans les autres cas, le spectre évolue continûment entre les fréquences les plus basses et les plus hautes.

Ces mathématiques ne s'appliquent rigoureusement qu'aux fonctions définies pour tout nombre. Mais les sons ont un début et une fin, et ils ne nous intéressent que parce qu'ils changent sans arrêt. On peut calculer, pour un échantillon sonore, un spectre d'autant plus précis que sa durée est grande[1]. Mais plus un son dure, plus ses caractères ont de chances de changer, et plus son spectre représente une moyenne de ses caractéristiques.

Pour décrire convenablement un son réel par son spectre il faut donc un compromis entre la précision avec laquelle on connaît le moment où un évènement sonore survient, qu'on appelle résolution temporelle, et le degré de détail avec lequel on connaît les fréquences qui sont présentes, appelée résolution fréquentielle.

Limites du spectre sonore[modifier | modifier le code]

Pour situer les valeurs nécessaires à ce compromis, la psychoacoustique a étudié les limites temporelles et fréquentielles de l'audition humaine, qui sont celles du spectre sonore :

- L'événement sonore le plus court que les personnes puissent isoler dure au moins 10 ms[2].

- Le domaine des fréquences auxquelles l'oreille humaine est plus ou moins sensible s'étend d'environ 16 Hz à environ 16 000 Hz[3].

- Dans le meilleur des cas, l'oreille humaine peut arriver à distinguer des sons qui diffèrent en fréquence d'environ deux savarts, soit un rapport de fréquences de 1 à 1,002. Cette performance se dégrade progressivement jusqu'à la proportion de 1 à 1,25 aux limites de l'aire audible, du côté des basses, des aigües, et des sons de faible intensité[4].

Pour d'autres espèces animales, les limites de l'audition sont différentes, et l'analyse des sons doit en tenir compte.

Instruments d'expérimentation et de mesure[modifier | modifier le code]

On savait depuis l'antiquité que la hauteur des sons musicaux dépend de la longueur des tuyaux ou des cordes qui les produisent. Au XVIIe siècle, des savants comme Marin Mersenne relient cette dimension à la notion de fréquence de vibration.

En étudiant la propagation du son dans les solides, Ernst Chladni fournit dès 1787 ses “Klangsbilder”, une image correcte, mais figée, des vibrations sonores ; à partir de la répartition en cours d’ébranlement vibratoire d’un amas de sable sur des plaques métalliques, Chladni procurait une figure acoustique des nœuds et des ventres de la vibration.

Vers 1850, de Martinville invente le phonautographe, qui donne une trace, sur papier, de l'onde sonore, représentée dans le domaine temporel. Les ondulations d'un son aigu apparaissent plus serrées que celles d'un son grave, et on peut, en analysant mathématiquement une forme d'onde périodique, déterminer très approximativement quelles sont les harmoniques qu'elle contient.

Quelques années plus tard, Hermann von Helmholtz fabrique des résonateurs calibrés qui permettent de décomposer, auditivement, un son complexe en partiels, et met en évidence l'importance de cette répartition dans la perception de la différence de timbre entre des sons musicaux continus comme ceux de la flûte et du violon.

Sonagraphe[modifier | modifier le code]

Grâce à l’électronique, cette construction purement intellectuelle et éminemment rationalisatrice, allait devenir une conceptualisation expérimentale de premier ordre en s’inscrivant dans l’évolution temporelle. On ne disposait pas encore du “film”, mais déjà d’un instantané plus précis, qui n’était plus uniquement une vue de l’esprit.

En 1939, le vocoder mis au point par l'équipe de Homer Dudley aux laboratoires Bell analyse la voix humaine en découpant le spectre de la voix humaine transmise par téléphone, de 300 Hz à 3 400 Hz, en douze bandes de fréquences, pour chacune desquelles on transmet les amplitudes, avec une fréquence maximale de 10 Hz par fréquence. À la réception, on combine des bruits filtrés avec les mêmes bandes de fréquence selon les coefficients transmis. On opère ainsi une analyse et une synthèse de la parole (surtout au niveau des voyelles) ; mais c'est une représentation formantique assez grossière, quoique nettement améliorée vers 1950 quand Manfred Schroeder a l'idée de transmettre la fondamentale, dans la bande des 150 Hz à 300 Hz, et de s'en servir pour générer des harmoniques à la réception qui sont ensuite filtrés et pondérés à la place des bruits utilisés précédemment.

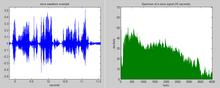

Le sonagraphe inventé dans les années 1940 dans les mêmes laboratoires permet la visualisation du spectre sonore. Les sonagrammes produits donnent une représentation visuelle de l'intensité sonore en fonction de la fréquence et du temps. Limités au départ à quelques secondes, enregistrées et analysées ensuite en plusieurs minutes, ils sont devenus capables de donner une indication en temps réel, et peuvent servir la représentation du signal dans des programmes d'enregistrement informatique.

Analyse par octave et tiers d'octave[modifier | modifier le code]

En 1952, Émile Leipp présenta son Intégrateur de densité spectrale destiné à l'analyse des sons instrumentaux, qui présentait le spectre sonore sur huit bandes[5]. À la même époque, les recherches sur le bruit de Eberhard Zwicker l'amènent à analyser le spectre sonore en 24 bandes, selon la sensibilité de l'oreille et l'effet psychoacoustique de masquage d'un son par un autre de fréquence proche[6]. Les possibilités ouvertes par l'électronique à circuit intégré firent des variantes de ces instruments, avec désormais la possibilité de mesure en temps réel, l'outil d'analyse spectrale le plus répandu à partir de 1990.

Des bancs de filtres, analogiques ou numériques, permettent d'évaluer la répartition de la puissance sonore entre les bandes de fréquences. Les filtres doivent avoir un gain nul à la fréquence centrale de leur bande, et diviser la puissance par deux à la moitié de l'écart relatif entre deux bandes, de façon à permettre une évaluation correcte de la puissance totale. Les valeurs doivent ensuite décroître suffisamment rapidement pour que les bandes au-delà de la bande adjacente affichent une valeur négligeable pour la fréquence centrale.

Un filtre d'octave centré sur 250 Hz doit passer intégralement un son pur à 250 Hz.

La largeur de la bande étant de une octave, la bande supérieure est centrée sur 500 Hz. Une fréquence de 250×√2= 354 Hz doit être atténuée de 3 dB.

La norme internationale ISO 266 (1997) prévoit les valeurs et des courbes de réponse pour les filtres d'octave et de tiers d'octave.

Les appareils affichent un histogramme où chaque barre verticale représente la valeur mesurée dans une bande de fréquences.

Analyseur de spectre[modifier | modifier le code]

Le développement du traitement numérique du signal permet d'afficher en temps réel la densité spectrale de puissance du signal sonore.

Compléments[modifier | modifier le code]

Articles connexes[modifier | modifier le code]

Lien externe[modifier | modifier le code]

Références[modifier | modifier le code]

- (en) Dennis Gabor, « Theory of communication : Part 1: The analysis of information », Journal of the Institute of Electrical Engineering, London, vol. 93-3, no 26, , p. 429-457 (lire en ligne, consulté le )

- Pour obtenir cette valeur, on demande aux sujets de compter des clics, de plus en plus rapprochés, dans des séquences où ils sont irrégulièrement espacés. Quand ils en manque un, par rapport au nombre généré par la machine, on conclut que le sujet a confondu en un seul évènement les deux plus rapprochés. Voir Émile Leipp, La machine à écouter : Essai de psycho-acoustique, Paris, Masson, .

- Michèle Castellengo, « La perception auditive des sons musicaux », dans Arlette Zenatti, Psychologie de la musique, Paris, Presses universitaires de France, coll. « Psychologie d'aujourd'hui »,

- Castellengo 1994, p. 65

- L'intégrateur de densité spectrale ; Gérard Pelé, Études sur la perception auditive, Paris, L'Harmattan, , p. 40.

- (en) Hugo Fastl et Eberhard Zwicker, Psychoacoustics : Facts and Models, Springer, , 463 p. (ISBN 978-3-540-23159-2, lire en ligne) ; voir Bark.